通过两周前发布 Grok-1 的模型权重和网络架构,我们展示了 xAI 截至去年 11 月所取得的进展。从那时起,我们在最新模型 Grok-1.5 中改进了推理和解决问题的能力。

能力与推理

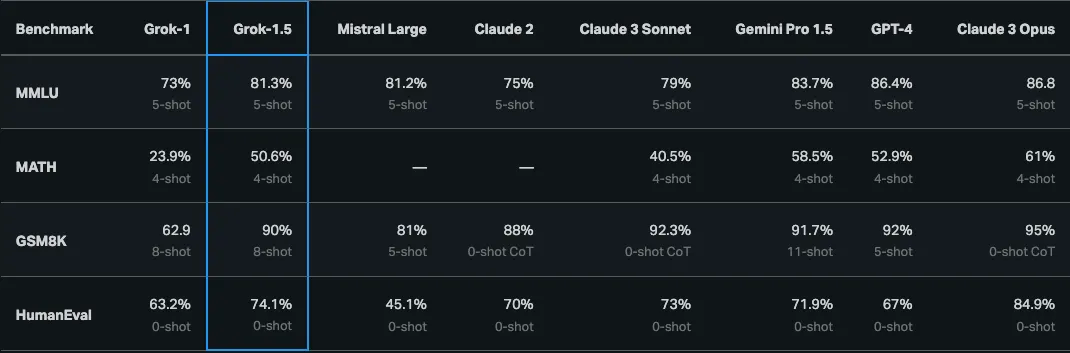

Grok-1.5 最显着的改进之一是它在编码和数学相关任务中的性能。在我们的测试中,Grok-1.5 在数学基准测试中取得了 50.6% 的分数,在 GSM8K 基准测试中取得了 90% 的分数,这两个数学基准涵盖了广泛的小学到高中竞赛问题。此外,它在 HumanEval 基准测试中得分为 74.1%,该基准测试评估代码生成和解决问题的能力。

长上下文理解

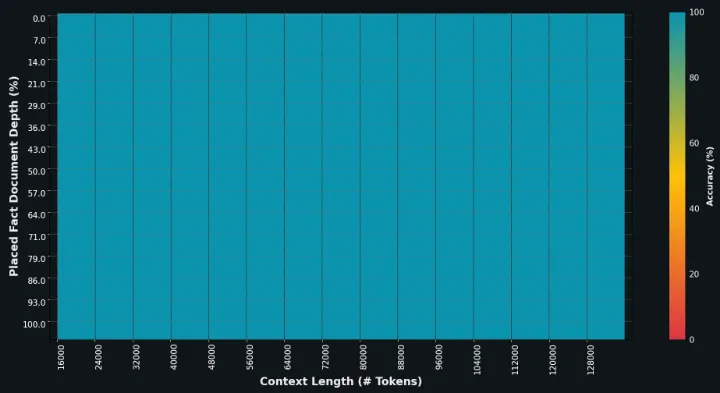

Grok-1.5 中的一个新功能是能够在其上下文窗口内处理多达 128K 个tokens的长上下文。这使得 Grok 的内存容量增加到以前上下文长度的 16 倍,使其能够利用来自更长的文档的信息。

此外,该模型可以处理更长、更复杂的提示,同时随着上下文窗口的扩展,仍保持其指令跟踪功能。在大海捞针 (NIAH) 评估中,Grok-1.5 展示了在长度高达 128K 个标记的上下文中嵌入文本的强大检索能力,实现了完美的检索结果。

Grok-1.5 Infra

在大规模 GPU 集群上运行的尖端大型语言模型 (LLM) 研究需要强大而灵活的基础设施。Grok-1.5 建立在基于 JAX、Rust 和 Kubernetes 的自定义分布式训练框架之上。这个训练堆栈使我们的团队能够以最小的努力对想法进行原型设计并大规模训练新架构。在大型计算集群上训练 LLM 的一个主要挑战是最大限度地提高训练作业的可靠性和正常运行时间。我们的自定义训练编排器可确保自动检测有问题的节点并将其从训练作业中弹出。我们还优化了检查点、数据加载和训练作业重启,以最大程度地减少发生故障时的停机时间。如果您对我们的培训堆栈感兴趣,请申请加入团队。

展望未来

Grok-1.5 将很快提供给早期测试人员,我们期待收到您的反馈,以帮助我们改进 Grok。随着我们逐步向更广泛的受众推出 Grok-1.5,我们很高兴在未来几天内推出几项新功能。